把“ChatGPT”装在机器人上,谷歌想要降维打击?

此岸的ChatGPT还没有出来,彼岸开始盯着下一代ChatGPT了。

这就是对物理世界有感知的ChatGPT。它可以直接接受人类的语言指令,就像与人类自然地对话那样,用动作与人类互动。

谷歌在被ChatGPT偷袭,被微软挑战戏弄,并且自赋“红码”三个月之后,放出了的一个大招。它推出了一个视觉语言模型PaLM-E,参数达到5620亿个,集成了视觉和语言,用于机器人控制。

相比大语言模型(LLM),它被称为视觉语言模型(VLM)。VLM与LLM不同之处,在于它对物理世界有感知。

从杨立昆到马库斯,都一直在批评ChatGPT并非人工智能的发展方向,因为它只是一个“单词预测的机器”,并不理解语言的含义,不了解物理世界,也不知道什么是真相。

1950年,图灵在他的论文《Computing Machinery and Intelligence》中首次提出了具身智能的概念。去年10月,杨立昆和本吉奥两位图灵奖获得者,联名一批致力于机器学习与神经科学结合研究的科学家,发表了催化NeuroAI革命的宣言:《通往下一代人工智能》。

他们提出具身图灵测试(The Embodied Turing Test)作为NeuroAI的终极挑战,其核心在于高级感觉运动能力,具体包括与世界互动、动物行为的灵活性、能源效率等特征。

所谓具身智能,是指具有身体体验的智能。所有的生物都是通过身体逐步产生智能的,只有沿着具身智能的方向,才会接近智能的本质。

当人工智能不仅仅是“耍嘴皮子”,而是身体力行地与周边环境互动,并且不断适应时,才形成了完整的智能。思想实验的“缸中之脑”,只能给人带来惊悚。

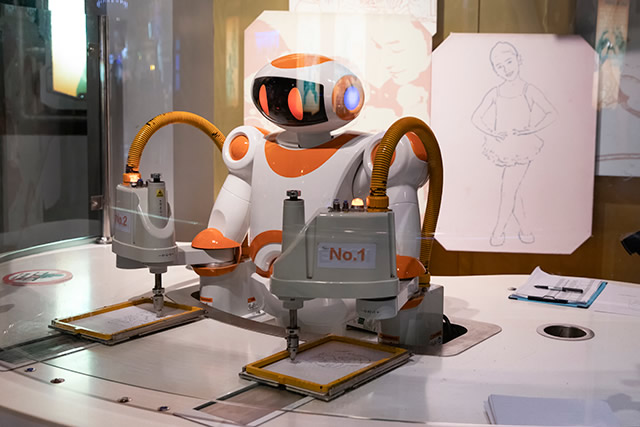

根据谷歌的说法,当给出一个高级命令时,比如“把抽屉里的米片拿给我”,PaLM-E可以为一个有手臂的移动机器人平台(由谷歌机器人开发)生成一个行动计划,然后机器人亲自执行。

PaLM-E分析来自机器人相机的数据,而无需预先处理好的场景表示。这样人类没有必要再预处理或标注数据,让机器人更自主地控制自己。

机器会产生韧性,并对环境做出反应。例如,PaLM-E模型会指导一个机器人去厨房取一袋米片,它在执行任务时,还能对付阻拦。当有人试图从机器人手中拿走米片并移走时,机器人能找到米片,再抓到手中。

被称为“PaLM-E”,是因为它基于谷歌现有的PaLM大型语言模型。谷歌通过添加感官信息和机器人控制,使PaLM“具身化”。

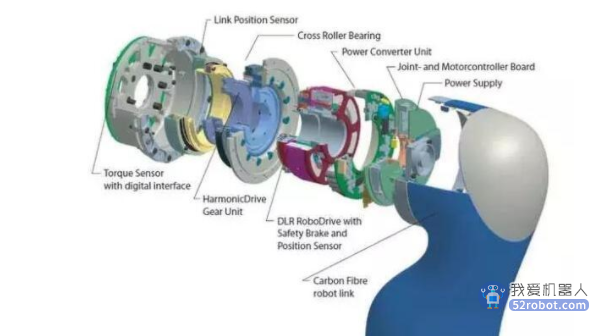

由于它基于语言模型,PaLM-E会进行连续观察,例如图像或传感器数据,并将它们编码为一系列与语言标记大小相同的向量。这样模型“理解”感官信息的方式,与处理语言相同。

除了RT-1机器人Transformer之外,PaLM-E还借鉴了谷歌之前在ViT-22B上的成果,这是 2 月份公布的视觉Transformer模型。ViT-22B 已经接受过各种视觉任务的训练,例如图像分类、对象检测、语义分割和图像字幕。

使用神经网络进行机器人控制,Google Robotics并不是唯一的研究团队。微软最近的ChatGPT for Robotics论文,尝试以类似的方式,将视觉数据和大型语言模型结合起来进行机器人控制。

除了机器人技术,谷歌研究人员还观察到一些有趣的效果,使用大型语言模型的PaLM-E,表现出“正迁移”,可以将从一项任务中学到的知识和技能迁移到另一项任务中,与单任务机器人模型相比具有“显著更高的性能”。

此外,他们还观察到模型的规模效应:“语言模型越大,在视觉语言和机器人任务训练时就越能保持其语言能力——从数量上讲,562B PaLM-E模型几乎保留了其所有语言能力。”

研究人员发现,尽管只接受了单图像提示的训练,PaLM-E展示了涌现能力,如多模态思维链推理(允许模型分析包括语言和视觉信息的一系列输入)和多图像推理(使用多个图像作为输入来做出推理或预测)。从这个意义上说,随着深度学习模型变得越来越复杂,PaLM-E涌现惊喜的趋势似乎会持续下去。

谷歌研究人员计划探索PaLM-E在现实世界场景中的更多应用,例如家庭自动化或工业机器人。他们希望PaLM-E能够激发更多关于多模态推理和具身AI的研究。

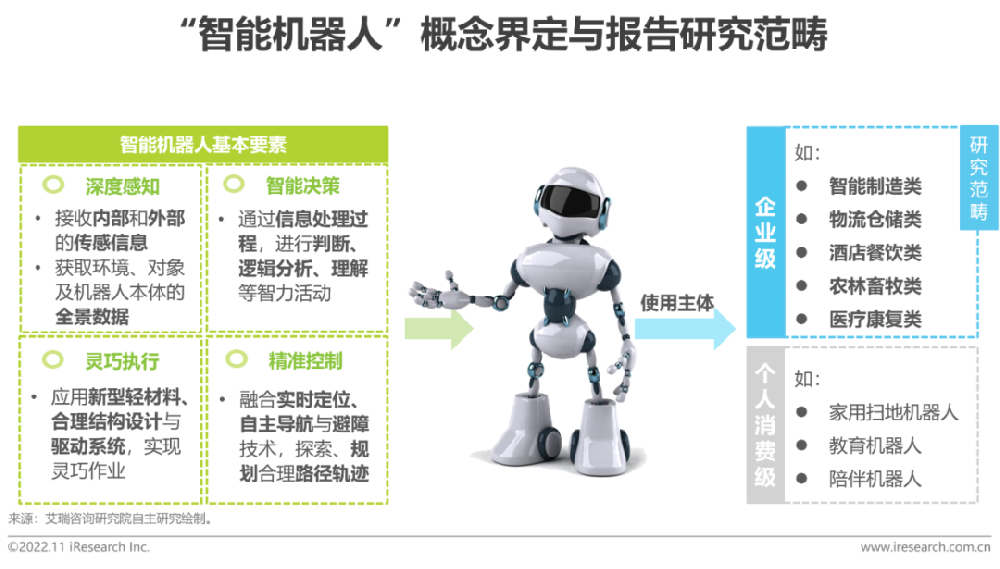

“多模态”在AI圈内流行,因为具身智能通向两个方向,一个是人形机器人,一个是通用人工智能。

声明:本站所有文章资源内容,如无特殊说明或标注,均为采集网络资源。如若本站内容侵犯了原著者的合法权益,可联系本站删除。