机器人“意识”曾被视为禁忌,如今成为最后的关键词

Hod Lipson是一名机械工程师,他领导着哥伦比亚大学的创意机器实验室,他的大部分职业生涯都围绕着他所在行业的一些人所谓的c字来塑造。

去年10月一个阳光明媚的早晨,这位出生于以色列的机器人学家坐在实验室的一张桌子后面解释自己的工作。“这个话题是禁忌,”他说,咧嘴一笑,露出门牙之间有轻微的缝隙。“我们几乎被禁止谈论它——‘不要谈论c字;你不会获得终身职位’——所以一开始我不得不伪装它,就像它是别的东西一样。”

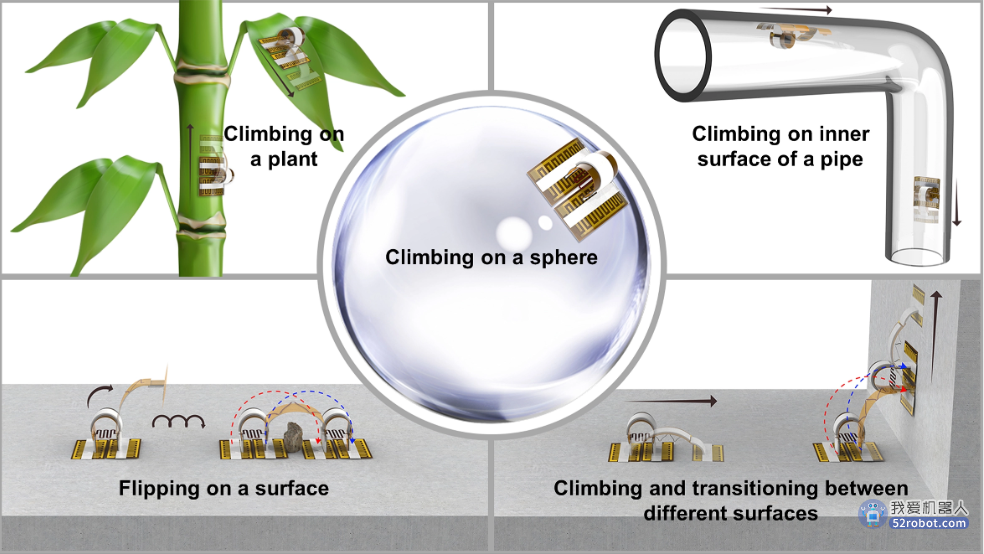

那是在21世纪初,当时Lipson博士是康奈尔大学的助理教授。他正在努力制造机器,这些机器可以记录他们自己的硬件出现问题——部件破损或布线故障——然后在没有程序员指导的情况下改变它们的行为以补偿这种损伤。就像狗在事故中失去一条腿一样,它可以教自己以不同的方式再次行走。

对这种内置的适应性,Lipson博士认为,随着我们越来越依赖机器,它会变得更加重要。机器人正被用于外科手术、食品制造和运输;机器的应用几乎无穷无尽,随着它们与我们的生活更加融合,其功能中的任何错误都可能意味着灾难。他说:“如果我们真的要把生命交给一个机器人,您会希望这些机器具有灵活性。”

做到这一点的一种方法是从大自然中汲取灵感。动物,特别是人类,善于适应变化。这种能力可能是数百万年进化的结果,因为应对伤害和不断变化的环境的复原力通常会增加动物生存和繁殖的机会。Lipson博士想知道是否可以在他的代码中复制这种自然选择,创造一种可推广的智能形式,无论该身体看起来如何,也无论该功能是什么,都可以了解其身体和功能。

这种智能,如果可能的话,将是灵活和快速的。在棘手的情况下,它会和人类一样好——甚至更好。随着机器学习越来越强大,这个目标似乎可以实现。Lipson博士因此赢得了聘期,他作为一名有创造力和雄心勃勃的工程师的声誉也越来越高。因此,在过去的几年里,他开始阐明他做所有这些工作的基本动机。他开始大声说出c字:他想创造有意识的机器人。

他说:“这不仅仅是我们正在研究的另一个问题——待解决的问题。”“这比治愈癌症更重要。如果我们能创造出一台与人类同等意识的机器,将使我们所做的一切黯然失色。那台机器本身可以治愈癌症。”

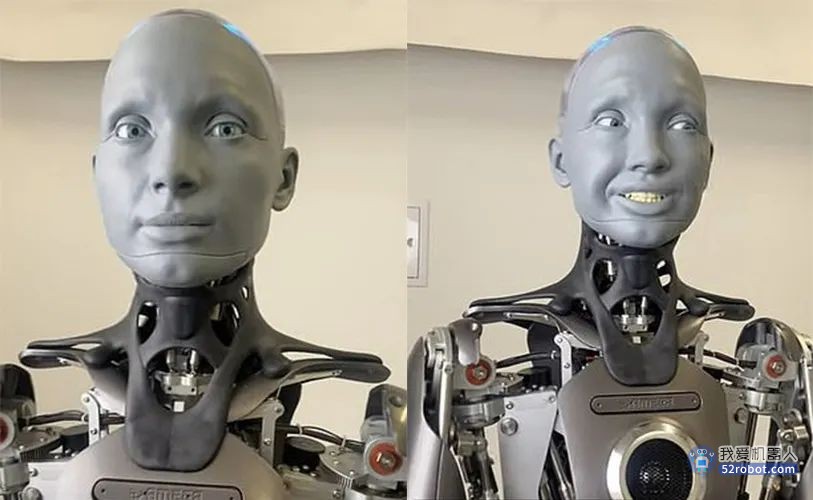

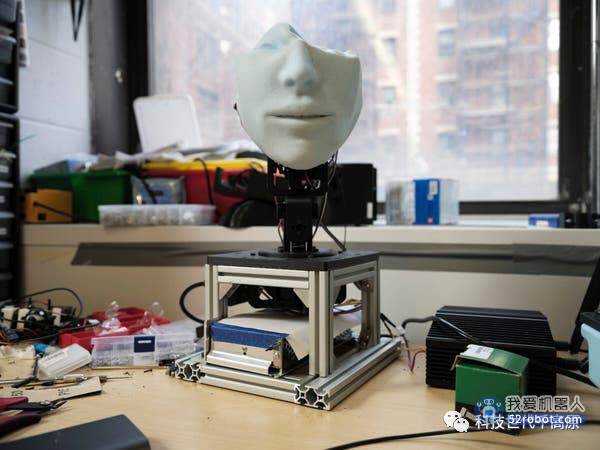

创意机器实验室,位于哥伦比亚Seeley W的一栋水泥楼,它被组织成盒子。房间本身就是一个盒子,分割成方形的工作站,内衬着盒状小隔间。在这个顺序中,机器人和机器人碎片散落在外。一张蓝色的脸从架子上茫然地凝视着;一台绿色蜘蛛般的机器从地上的篮子里伸出双腿;一个精致的蜻蜓机器人在工作台上保持平衡。这是机械思维的进化浪费。

研究c字的第一个困难是,人们对它的实际含义没有达成共识。许多模糊的概念就是这种情况,如自由、意义、爱和存在,但这个领域通常应该留给哲学家,而不是工程师。有些人试图对意识进行分类,通过指向大脑的功能或一些更形而上学的物质来解释它,但这些努力几乎没有结论,并引发了更多的问题。即使是对所谓现象意识最广泛分享的描述之一——正如哲学家Thomas Nagel所说,一个机体是有意识,“如果它其中有些东西如同机体那样”——也会感到不清楚。

对于机器人学家和计算机科学家来说,直接涉水进入这些阴暗的水域似乎毫无结果。但是,正如意大利巴勒莫大学机器人学家Antonio Chella所说,除非考虑到意识,否则会感觉智能机器的功能“好像缺少了什么”。

对人类特征的调用可以追溯到1955年人工智能研究的曙光初起时。当时达特茅斯的一群科学家追问,机器如何“解决现在留给人类的各种问题,并改善自己”。他们希望在机器中模拟大脑的先进能力,如语言、抽象思维和创造力。意识似乎是其中许多能力的核心。

但试图使用可操作的输入和函数渲染粘稠的c字是一项困难(如果不是不可能的话)的任务。大多数机器人学家和工程师倾向于跳过哲学,形成自己的功能定义。麻省理工学院机械工程名誉教授Thomas Sheridan说,他认为意识可以简化为某个过程,我们对大脑的了解越多,这个概念看起来就越模糊。他说:“最初是幽灵般的宗教,最终变成了一种直截了当、客观的科学。”

这些观点不仅为机器人学家所持有。Daniel Dennett和Patricia Churchland等哲学家以及神经科学家Michael Graziano等人提出了各种功能化的意识理论。

Lipson博士和Creative Machines Lab的成员属于这一传统。他说:“我需要一些完全可建造、干燥、不浪漫的东西,只有螺母和螺栓。”他确立了一个实用的意识标准:想象自己的未来的能力。

在Lipson博士看来,意识类型之间的根本区别——例如,人类意识、章鱼意识和老鼠意识——是一个实体能够想象到自己多远的未来。意识存在于一个连续体上。一端是一个有机体,它对其在世界上的位置有一种感觉——一些原始的自我意识。除此之外,还有想象你的身体未来会在哪里的能力,除此之外,还有想象你最终可能想象到的事物的能力。

“因此,最终这些机器将能够理解它们是什么,以及它们的想法,”Lipson博士说。“这会导致情绪和其他事情。”目前,他补充说:“我们正在做蟑螂版本。”

采取意识的功能理论这一立场的好处是,它允许技术进步。

创意机器实验室最早出现的自我意识机器人之一有四条铰链腿和一个黑色机身,传感器在不同点连接。通过四处移动并注意到进入传感器的信息是如何变化的,机器人为自己创建了一个棒状图形模拟。当机器人继续移动时,它使用机器学习算法来改善其自身的模型和实际身体之间的贴合度。机器人使用这个自我图像在模拟中找出了一种前进的方法。然后,它将这种方法应用到它的身体上:在无需告诉它如何行走的情况下,它自己学会了如何行走。

在创意机器实验室工作的杜克大学机器人学家陈博士(Boyuan Chen)说,这是向前迈出的重要一步。他说:“根据我之前的经验,每当你训练机器人发展新能力时,你总会看到一个人站在一边。”

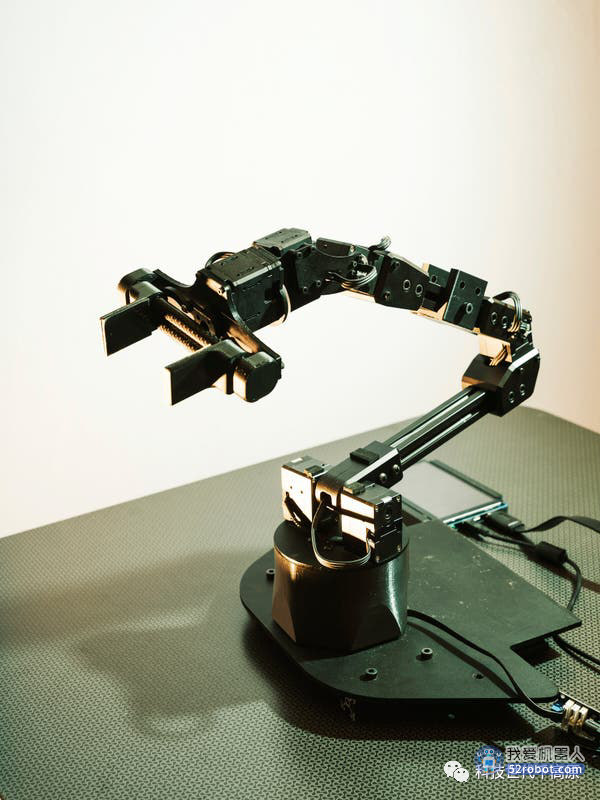

最近,陈博士和Lipson博士在《科学机器人》杂志上发表了一篇论文,揭示了他们最新的自我意识机器,这是一种固定在桌子上的简单双关节手臂。使用周围设置的摄像头,机器人可观察自己移动——“就像一个婴儿在摇篮里,在镜子里看着自己,”Lipson博士说。最初,它不知道它在太空中的位置,但在几个小时内,在强大的深度学习算法和概率模型的帮助下,它能够在世界上脱颖而出。“它有这样一种自我的概念,如同一朵云,”Lipson博士说。

不过,它真的有意识吗?

致力于任何意识理论的风险在于,这样做会招致各种可能的批评。当然,自我意识似乎很重要,但意识没有其他关键特征吗?如果我们感觉不到有意识,我们可以称之为有意识的东西吗?

Chella博士认为,没有语言,意识就不可能存在。而他一直在开发的机器人可以形成内部独白,对自己讲道理,并反思他们周围看到的东西。他的一个机器人最近能够在镜子中认出自己,通过了动物可能具有自我意识的最著名的测试。

佛蒙特大学机器人学家、创意机器实验室前成员Joshua Bongard认为,意识不仅包括认知和精神活动,而且本质上是一个身体方面。他开发了一种被称为异种机器人的生物,完全由青蛙细胞连接在一起,以便程序员可以像机器一样控制它们。根据Bongard博士的说法,不仅仅是人类和动物进化到适应周围环境并相互互动;我们的组织已经进化到可以征服这些功能,我们的细胞也进化到可以征服我们的组织。他说:“我们是由智能机器制成的智能机器,一直都是由智能机器制成的智能机器。”

2022年夏天,大约与陈博士和Lipson博士发布他们最新的机器人的同时,一位谷歌工程师声称,该公司新改进的聊天机器人LaMDA是有意识的,应该像对待小孩一样对待它。这一说法遭到了怀疑。Lipson博士指出,主要是因为聊天机器人正在处理“为完成任务而编写的代码”。其他研究人员说,意识没有潜在的结构,只有对意识的想象/错觉。Lipson博士补充说:“机器人并没有自我意识。这有点像作弊。”

而对这么多存在的分歧,谁能说什么是作弊呢?

加州大学里弗赛德分校的哲学教授埃里克·施维茨·格贝尔(Eric Schwitzgebel)写过关于人工意识的文章。他指出,这种普遍不确定性的问题是,按照事情进展的速度,在我们商定意识标准之前,人类可能会开发出一个许多人认为有意识的机器人。当这种情况发生时,机器人应该被授予权利吗?可以赋予它自由吗?当它为我们服务时,它应该被编程为感到幸福吗?人们会允许它为自己说话吗?它们可以有权投票吗?

这些问题在Isaac Asimov和Kazuo Ishiguro等作家的书籍以及《西部世界》和《黑镜》等电视节目中推动了科幻小说的整个子流派。

围绕所谓的道德可感知性的问题是动物权利辩论的核心。如果一只动物能感觉到疼痛,那么为了吃肉杀死它是不是错了?如果动物不能像人类那样体验事物,这是否意味着我们可以利用它们让自己得到享受?动物是否具有某种意识能力,似乎往往会影响到它是否拥有某些权利,但对究竟哪些意识能力更重要,人们并没有达成共识。

面对这种不确定性,Schwitzgebel博士倡导他所谓的“排除中间地带的设计政策”(“the design policy of the excluded middle.”)。这个想法是,我们只应该创造我们认为在道德上绝对无关紧要的机器——或者绝对重要的机器。从各种角度来看,意识和物质灰色地带中的任何东西都可能造成严重伤害。

牛津大学人类未来研究所的哲学家Robert Long支持这种谨慎。他说,大型研究实验室和公司的人工智能开发给他一种“迈向一个充满我们尚未准备好的各种未知和令人烦恼的问题的未来”的感觉。一个著名的问题是制造可以消灭人类人口的超级智能机器的可能性,而开发被广泛认为有意识的机器人将增加应对这些风险的困难。Long博士指出:“我宁愿生活在一个事情进展得更慢的世界里,人们会更多地思考他们在这些机器里放些了什么。”

但谨慎的缺点是技术发展放缓。Schwitzgebel和Long承认,这种更深思熟虑的方法可能会阻碍更具弹性和更有用的人工智能的发展。对于实验室里的科学家来说,这种抽象的理论可能会让人感到沮丧。

当被问及创造具有与人类相似意识能力的机器人的风险时,Chella博士指出,“我认为我们没有接近这种风险”。Lipson博士补充说:“我很担心,但我认为好处大于风险。如果我们走上这条越来越依赖技术的道路,技术需要变得更有弹性。”

他进一步指出:“然后是想要创造生命的傲慢。这是终极挑战,就像去月球一样。”而且这将比登月更加令人印象深刻,他后来又说。

在创意机器实验室的一个工作站里,一个有自我意识的机械手臂开始移动。实验室的研究生胡宇航(Yuhang Hu)已经启动了一个机械序列。目前,机器人并没有观察自己,也没有形成一个自我模型——它只是随机地移动,每秒钟扭曲或移动一次。就算它将可能能产生意识,目前还没有。

Lipson博士靠在椅子上,看着机器人,然后对胡先生说:“我们需要做的另一件事是让这个机器人通过撞到东西来制作自己的模型。”

头发蓬乱的胡先生,用手撑着下巴答道:“是的,这很有趣。”

Lipson博士继续说:“因为即使是盲人也可以形成自己的形象。”

“你可以在上面放一个盒子,”胡先生说。

“对,”博士Lipson说。“它必须是一个足够丰富的环境,一个游乐场。”

两位科学家坐在那里思考或若有所思,盯着继续在桌子上移动的机器人。

Lipson博士指出,他的实验室就是这样做研究的。研究人员向内观察,注意到自身的一些因素——身体的自我意识,对周围环境的感知,对他人的自我意识——然后尝试将这些因素放入机器中。“我希望尽我所能推动这一进程,”Lipson博士说。“我希望机器人能思考自己的身体,思考自己的计划。”

在某种意义上,这是所有机器人练习中最简单的,就像小学生用老式电子设备做的事情一样。如果你能用一台退役的打印机做这件事,为什么你不能用你的心灵做这件事呢?分解它,看看它是如何工作的,然后尝试重新构建它。

声明:本站所有文章资源内容,如无特殊说明或标注,均为采集网络资源。如若本站内容侵犯了原著者的合法权益,可联系本站删除。