科学家用智能机器人操作摄影机,可减少视频制作者的负担

相信很多读者都从各种长短视频平台上学到过一些有用的动手技能,比如烹饪、维修、美妆等等。这些可能是点滴小事,但是做得好的话可以切实地提升生活质量。

另外,动手技能的培训在很多职业的发展中也非常重要,例如在制造、护理、物理治疗这些行业中,操作技能的高低与服务质量和生产质量息息相关。

传统的动手技能培训采用面对面教学的方式,受到时间空间上的诸多限制。通过视频进行教学可以突破这些限制,让更多人受益。

但是,如果大家有做教学视频的经验的话,会发现这是一个非常繁冗的工作。仅仅是调整摄影机、寻找好的摄影机角度这一部分,就可能需要多轮反复。

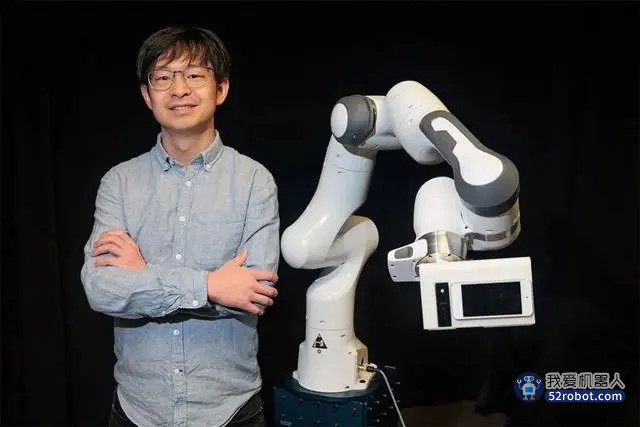

因此,加拿大多伦多大学李健楠和所在团队希望通过智能机器人操作摄影机,减少视频制作者的负担。从交互研究的层面,这项研究希望探索机器人如何通过人类隐性的沟通信号,来理解人的意图从而提高人与机器人合作的质量。

图 | 李健楠(来源:李健楠)

谈到人和机器人的合作,大家更熟悉的还是一些显性的沟通方式,比如通过代码、图形界面、或者自然语言,直接命令机器人去完成一项任务。

但是在紧耦合的合作中,比如由机器人拍摄人的表演,或者人与机器人一起组装一个设备时,这类沟通方式对人类会产生负担,因为我们必须暂时从手头工作中抽离才能发出这些命令。

在视频拍摄的情景之下,讲解者在给观众示范动手技能的同时,还要给机器人下命令,那讲解的过程就可能会变得支离破碎。

人类在合作和沟通方面,其实有很多细微的技巧。在合作中,我们不光会关注对方的显性命令和建议,还会关注种种隐性的信号,比如对方身体的朝向、手势,还有和其他人的对话,以此理解对方的目标。

因此,李健楠所在团队希望探索能否让机器人也拥有这种能力,从而减少人类在与机器人合作时在沟通上的体力脑力资源。

具体在视频拍摄中,让机器人关注讲解者和观众的沟通信号,以此决定摄影机的位置和角度等参数。

事实上,当今市场上已经有云台和无人机等摄影机器人。随着机器人成本的降低和感知能力的提高,相信今后会有更多专门面向个人和小型工作室的消费级摄影机器人。但是,现在的摄影机器人依旧非常依赖人给出明确的指令,无法很好地应对变化的场景。因此,李健楠希望这项研究可以启发摄影机器人的交互设计,让它们去主动理解人类的意图。

据介绍,李健楠一直关注如何通过机器人摄影,去提高动手技能教学的体验。而关于本次研究的想法,则起源于他的上一个项目。

在上一个项目中,他和同事采用观众和讲解者共同控制的机器人集群去拍摄教学视频。实验中,他们发现该方法的一个局限在于,观众和讲解者还是要为控制机器人而分心,导致教学体验受到影响。

因此,他们希望可以减少这些负担。但是,视频摄制涉及理解环境和视频内容走向,如果没有任何用户输入的话,依旧很难交给机器人进行自动执行。

在本次研究的前期,李健楠等人主要思考的是:如何能让拍摄者快速制作分镜头脚本(故事板),然后输入给机器人。

之后,他们意识到很多业余型内容创作者并没有能力、精力、或意愿去制做故事板,而且在讲解过程中会有一些自由发挥的部分。

所以这个项目在初期停滞了很久,大家一直在构思如何简化故事板,但是不太顺利。后来受到一些文献的启发,他们决定关注让机器人理解人和人的沟通过程,也就是理解讲解者和观众交流中的信号比如姿态、手势和语言,从而来控制机器人的行为。

为此,他们研究了动手技能教学视频的内容,去了解创作者想要的摄影主体、角度等参数,之后选择了一系列可以与这些摄影机参数结合的沟通信号。在这之后,他们邀请拥有视频拍摄经验的用户参与试用和改善设计。

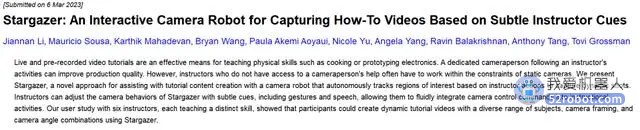

目前,相关论文以《观星者:基于讲解者微妙信号摄制教学视频的交互式相机机器人》(Stargazer: An Interactive Camera Robot for Capturing How-To Videos Based on Subtle Instructor Cues)为题发在人机交互顶级会议 ACM CHI 2023[1]上。论文也可见于预印本平台 arXiv[2]。

(来源:ACM CHI)

此外,李健楠表示:“我感兴趣的一个方向是拓展机器人可以理解的沟通信号。目前,这款系统能够理解的信号种类和内容还是有所局限,会对创作者的发挥造成限制。希望可以结合人工智能特别是大模型,来拓展机器人可以理解的信号范围。”

另据悉,2023 年七月李健楠即将入职新加坡管理大学计算与信息系统学院担任助理教授。今后,他会继续推进人和机器人交互的研究,专注于运用人工智能以及交互设计的方法,帮助机器人从隐性的信号解读人的意图,提高人与 AI 合作的成效。

另外,他也计划将这类方法推广到更多的智能系统问题中,比如增强现实环境,让智能系统更好地理解用户的愿望和偏好,在无需用户输入的情况下,为用户提供及时且有效的支持。

其最后表示:“新加坡管理大学有一个实力强劲的人机交互研究中心,教授们的研究方向除了人与机器人交互外,还涉及到数据可视化、无障碍计算、以及空间计算等方向。我现在正招收 2024 年入学的博士生,以及 2023 年下半年即可入职的研究助理。期待有兴趣的同学可以加入我们。”

参考资料:

1.Li, J., Sousa, M., Mahadevan, K., Wang, B., Aoyagui, P. A., Yu, N., ... & Grossman, T. (2023, April). Stargazer: An Interactive Camera Robot for Capturing How-To Videos Based on Subtle Instructor Cues. In Proceedings of the 2023 CHI Conference on Human Factors in Computing Systems (pp. 1-16).

2.https://arxiv.org/abs/2303.03221

个人网站:http://www.jiannanli.net

新加坡管理大学人机交互:https://smuhci.com/

项目视频:https://www.bilibili.com/video/BV1j14y1S7BH/

声明:本站所有文章资源内容,如无特殊说明或标注,均为采集网络资源。如若本站内容侵犯了原著者的合法权益,可联系本站删除。