特斯拉人形机器人伤人,安全风险究竟在哪儿?

近日,美国特斯拉得州超级工厂的一名工程师在维修机器人时被抓伤。与以往类似的机器人安全事故一样,该事件被媒体广泛报道,甚至用“机器人暴起伤人”“机器人突然袭击”之类的标题吸引公众眼球。

实际上,所有的劳动场所尤其是现代化工厂,均存在各种安全隐患,管理方历来高度重视安全问题。德国社会学家乌尔里希·贝克在其《风险社会》一书中就提出,当代社会是风险社会,危险大幅增加是当代社会的重要特征,因而安全问题更加突出。

因此,工厂机器人出现安全事故,本是件平常的事,却被媒体添加了许多神秘色彩,认为机器人安全事故与其他安全事故不同,因为机器人“有想法”,可能“主动”伤害人,甚至称这是机器人“觉醒”的结果。在很大程度上,此类报道是对机器人安全风险的夸大。

自20世纪五六十年代人工智能(AI)概念提出后,每一波AI热潮中“AI觉醒”都会被讨论。1997年,国际象棋机器人深蓝(Deep Blue)击败俄罗斯国际象棋大师,有人就觉得它已经有了意识,甚至还编造Deep Blue输给了人类棋手后恼羞成怒放电杀死对手的假新闻。2016年,阿尔法围棋(AlphaGo)大败围棋世界冠军李世石,又有人认为AlphaGo有意识了。总之,经过不断炒作,“AI觉醒”已成为AI文化乃至流行文化的重要话题。

早在20世纪90年代就有一些学者指出,“AI觉醒”“超级AI”是AI圈子“吸金”和“吸睛”的法宝——通过类似问题的娱乐化讨论来宣传AI,吸引资金流向AI,从而壮大自身。

在AI实际发展历程中,类似“AI觉醒”的宣传术的确起到很好的推动效果。第一,它抓住了人们的“痒点”,由于很多人觉得类似问题很好玩、很有趣,因此它特别适合成为娱乐元素;第二,它抓住了人们的“痛点”,宣传超级AI马上到来很可能统治人类,会让人们害怕;第三,它抓住了社会的“热点”,因为超级AI无所不能,甚至能解决气候变化等热点问题,于是所有的热点问题都被纳入AI宣传术当中。

正是在“AI觉醒”的宣传氛围中,机器人安全问题才被媒体特别关注,并以一种拟人化的口吻进行报道。实际上,迄今为止并没有证据表明机器人有任何“觉醒”的迹象。因此,与以往劳动安全问题相比,机器人并没有什么特殊的地方,不可夸大机器人安全问题。

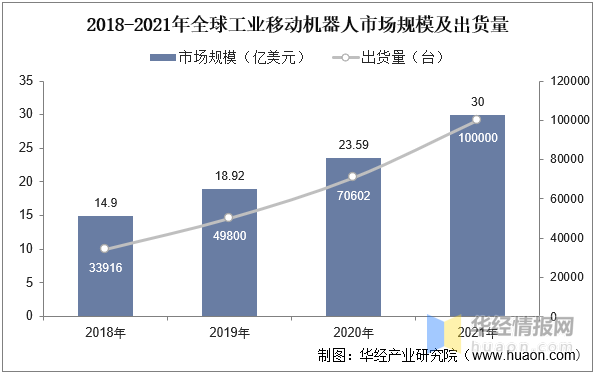

当然,机器人安全问题虽然没有特殊之处,但并不代表我们可以忽视它。智能革命方兴未艾,机器人替代人类劳动的情况越来越流行,全面自动化的“黑灯工厂”越来越普遍,与机器人相关的安全风险必然越来越大,毫无疑问将受到国家、企业、社会和劳动者的更多关注。

有意思的是,“机器人觉醒”的想法既可能让人们觉得机器人安全问题很特殊,也可能让大家忽视它。为什么?一些人可能认为,机器人有意识、有想法、有道德,不是“死”机器,能判断可能出现的危险,因此不容易出现安全问题。

因此,这些人在操作、维护和检修机器人时,可能会麻痹大意,忽视可能出现的危险。比如,在特斯拉机器人伤人的新闻中,维修工程师应该事先关闭电源,或者阻断机器人的运动功能。

总之,要正确看待机器人安全风险,既不可夸大,亦不可忽视。

在正确看待的基础上,国家、企业、社会和劳动者必须重视防范机器人安全风险,保护劳动者在生产过程中的安全。显然,安全是一项以人为本的复杂、系统、科学和细致的工作。机器人安全文化建设应更加系统地对待机器人安全问题,既包含与机器人相关的安全科学、安全教育、安全管理、安全法制等精神、制度领域,也包含与机器人相关的安全技术、安全工程等物质领域,必须全面进行建设。

针对机器人安全工作,要专门进行研究,制定严格的规章制度,在劳动场所认真落实,由此掌握安全工作的主动权,着力于事前预防,而不是事后补救。

目前,大家的机器人安全意识还不强,因此要特别强调宣传教育在机器人安全文化建设中的关键作用。机器人安全文化宣传教育的目的,就是要利用文化从更深层次影响企业员工的观念、道德、态度、情感和品行等,帮助树立“安全第一”“以人为本”的安全价值观,形成“关注安全”“关注生命”的安全理念,提高与机器人相关的安全素质和安全修养,加强安全责任心和使命感,最终使其行为自觉满足机器人安全的需要。

声明:本站所有文章资源内容,如无特殊说明或标注,均为采集网络资源。如若本站内容侵犯了原著者的合法权益,可联系本站删除。