谷歌开发乒乓球机器人:一回合可接球340次,探索动态高速人机互动

机器人学习目前已经被广泛应用于现实世界,并可以完成精密的手部、腿部动作。但在动态且高速的人机互动中,机器人学习并不常见。谷歌选择开发乒乓球机器人,正是为了探索这类情况下人工智能的可能性。

使用i-Sim2Real这种方式,在模拟环境下可以让数年的实时训练在几分钟或几小时内完成。

谷歌i-Sim2Real项目乒乓球机器人与人类训练。本文图片来源:谷歌

似乎现存的每一种桌上运动中,人工智能都立于不败之地。乒乓球竞技中,谷歌AI同样难逢敌手。10月18日,谷歌公布其正在研究的“乒乓球机器人”项目,在与人类对打时一回合可接球340次。目前,谷歌强调这只是人类与AI的“合作”,并非击败人类,但以AI成长的速度,它将很快成为专业选手。

机器人学习目前已经被广泛应用于现实世界,并可以完成精密的手部、腿部动作。但在动态且高速的人机互动中,机器人学习并不常见。谷歌选择开发乒乓球机器人,正是为了探索这类情况下人工智能的可能性。

解决“先有鸡还是先有蛋”

在这个名为i-Sim2Real的项目中,谷歌的乒乓球机器人在模拟环境中不断学习,并将学习成果运用于现实世界,最终可以在一个与人类的乒乓球接发回合中,接球超过三百次。它还能把球送回不同的区域,虽然不能精确到数字上,但已经足够精确到让机器人规划策略,来控制乒乓球的最终目的地。

谷歌之所以选择乒乓球运动,是因为机器人可以与快节奏以及相对不可预测的人类行为进行交互,同时乒乓球的规则相对于篮球、板球等运动也较为简单直接。机器人完成乒乓球动作时,既要求速度又要求精度,这对学习算法提出了很高的要求。同时,这类运动具有固定的、可预测的环境,使其成为研究人机交互和强化学习问题的理想测试平台。这些特性使得谷歌开发了i-Sim2Real项目。

i-Sim2Real也不仅仅是关于乒乓球机器人,更是一种人工智能创造过程的方式,在这个过程中,机器学习模型被教会在虚拟环境或模拟中做什么,然后再应用这些知识,目标是尽可能长时间地与人类进行接球回合而不失误。在现实世界中直接与人类玩家进行训练既繁琐又耗时,当需要数年的试验和错误才能建立一个工作模型时,使用i-Sim2Real这种方式显得十分有效,它在模拟环境下可以让数年的实时训练在几分钟或几小时内完成。

这种方式听起来简单高效,但在模拟中机器人并不是万能的。人类的活动具有一定的不可预测性,并不容易模拟,需要先有人类的行为模型作为支撑。而人类的行为模型,又需要与机器人互动获得。这就陷入了一个“是先有鸡还是先有蛋”的死循环。

i-Sim2Real解决这一鸡和蛋问题的方法,是使用一个简单的人类行为模型作为近似起点,并让机器人在模拟训练和现实训练之间交替学习。在每次迭代中,都会细化人类行为模型和策略。在机器人接近人类行为的过程中,初期的不理想是可以接受的,因为机器人也只是刚刚开始学习,之后每一场比赛都会收集更多真实的人类数据,提高准确性,让AI学到更多。

i-Sim2Real的训练方法。

GoalsEye:通过自我监督来自主练习

除了i-Sim2Real这种模拟与现实交替进行的方法,研究人员也在探索只使用现实的数据学习的方法,即GoalsEye项目。

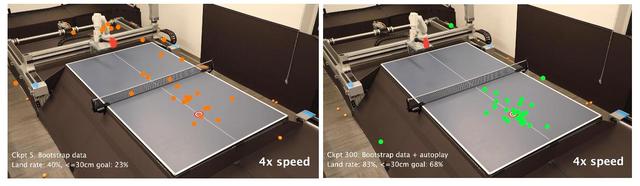

一开始,模仿学习(IL)为研究人员提供了一种简单而稳定的思路,但它需要人类行为进行演示,并且机器人的技术无法超过演示者的水平。同时,当演示者拥有在高速环境下精确接球的能力时,收集其数据具有一定挑战性,而且在刚开始时可能非常低效。因此研究人员尝试了一种结合最近行为进行重复的方法,从一个小的、结构薄弱的、非目标数据集开始,不断学习精确定位目标的策略。

这种方法使得在训练的过程中,机器人的自主学习能力显得至关重要。研究人员设置了一个强调精度的乒乓球任务,要求机器人将球返回到桌子上的任意目标位置。机器人可以通过自我监督来实现自主练习。例如,机器人可以设置随机目标,“击中左后角”或“将球从右侧过网”,并尝试使用当前掌握的策略来实现这些目标,从而不断改进。所有尝试都会记录并添加到不断扩展的数据集中。这种自主练习是反复进行的,机器人通过不断的设置随机目标并尝试目标,从而扩展训练数据,调整策略。

GoalsEye策略旨在实现直径20厘米的目标(左)。人类玩家瞄准同一个目标(右)。

GoalsEye的训练方法。

其效果也是显而易见的,在进行最初的2480次人类行为演示后,机器人只在9%的情况下能准确地达到距离目标30厘米以内的目标。然而,当机器人又自主练习了大约13500次后,达到目标的准确率上升到43%。同时,演示数量的提升提高了后续自我练习的效率,这说明,计算时间、成本等因素后,演示可以适当替换自我练习,从而更高效的进行训练。

在这两个使用机器人乒乓球研究平台的互补项目中,i-Sim2Real可以在模拟与现实中交替学习策略,而GoalsEye则证明,从现实世界的非结构化数据中学习,结合自我训练,对于在精确且动态的要求中学习目标条件策略是有效的。

声明:本站所有文章资源内容,如无特殊说明或标注,均为采集网络资源。如若本站内容侵犯了原著者的合法权益,可联系本站删除。